Pfadnavigation

Verwendung der Zero Density Reality Engine™ mit AW-UE150 und AW-UE100 für virtuelle Studio-Anwendungen

Zero Density Reality Engine™

Ermöglicht den Zugang zu einem leistungsstarken, hochwertigen und erschwinglichen AR-System für die Anforderungen Ihres virtuellen Studios!

Key features of Zero Density Reality Engine™

Hauptmerkmale

| Die AW-UE150 und AW-UE100 stellt der VR-Engine dank der Unterstützung des FreeD-Protokolls Echtzeit-Trackingdaten zur Verfügung. |

| Es ist also nicht erforderlich, ein zusätzliches Tracking-System zu kaufen. |

| Die Datei für das Kameraobjektiv ist für die Verwendung mit der Reality Engine™ bereit. Keine Objektivkalibrierung nötig! |

| Die Installation wird drastisch vereinfacht. |

| Gleichzeitige UHD- und HD-Ausgabe |

Die Panasonic PTZ-Kameras AW-UE150 und AW-UE100 in Broadcast-Qualität bieten Position Data Notification (PTZF) und unterstützen das FreeD-Protokoll, um mit virtuellen Studios und Augmented Reality-Anwendungen (AR) kompatibel zu sein. Durch die Übernahme des FreeD-Protokolls sind die AW-UE150 und AW-UE100 mit der Software "Reality Engine" von Zero Density kompatibel. Die Kombination aus Panasonic AW-UE150 und AW-UE100 PTZ-Kameras und Reality Engine macht AR einfach zugänglich und erschwinglich.

Die V-Log-Funktion wurde ab Version 2.9 in die Reality Engine implementiert und erhöht die Bildqualitätserfassung von Panasonic-Kameras wie der UE150, UE100, AK-UC4000 und VariCam LT. Die oben genannten Kameras haben die Fähigkeit, V-Log auszugeben, was bedeutet, dass das Videosignal innerhalb der Zero Density Reality Engine nativ verarbeitet werden kann, was eine bessere Ausgabe im Keyer ermöglicht und die Gesamtqualität in der virtuellen Studioproduktion erhöht.

Verwendung der Zero Density Reality Engine™ mit AW-UE150 und AW-UE100 für virtuelle Studio-Anwendungen

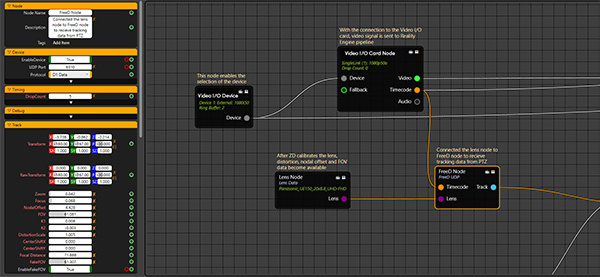

Die AW-UE150 und AW-UE100 liefern die Echtzeit-Positionierung an die Virtual Reality Engine™. Die Kamera wird dann "getrackt" und die FreeD-Daten werden über serielle oder IP-Verbindungen gesendet.

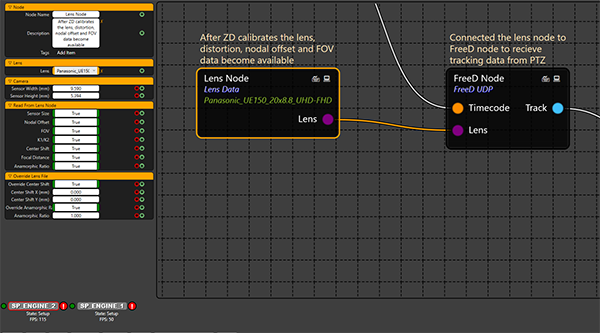

Objektiv-Node

Das Objektiv der Kamera ist bereits im Zero Density-System kalibriert und muss lediglich im Objektiv-Node ausgewählt werden. Die Kamera kann natürlich sowohl in Full HD als auch 4K verwendet werden. Kurzum: Die Verwendung der AW-UE150 und AW-UE100 in Kombination mit der Zero Density Reality Engine™ ermöglicht viel mehr Benutzern den Zugang zur Welt von AR und VR dank dieser leistungsfähigen, hochwertigen und erschwinglichen Lösung.

Tracking-Node

Die Reality Engine™ von Zero Density ist der ultimative node-basierte Echtzeit-Compositor, der Pipelines für visuelle Echtzeit-Effekte ermöglicht und Video-E/A, Keying, Compositing und Rendern in einer einzigen Software in Echtzeit bietet. Als führende virtuelle Studioproduktions-Lösung in Sachen Fotorealismus bietet die Reality Engine™ ihren Kunden die Tools, die zum Erstellen von Inhalten mit höchstmöglicher Immersion erforderlich sind. Dadurch wird das Storytelling in der Rundfunk- und Medien-, aber auch in der Kinobranche revolutioniert.

Reality Node Graph Pipeline

Die Reality Engine™ verwendet die Unreal Engine von Epic Games als 3D-Renderer, die führende Echtzeit-Game Engine beim Fotorealismus. Mit ihren erweiterten Fähigkeiten bei visuellen Echtzeit-Effekten bietet die Reality Engine bei der Composite-Ausgabe das größtmögliche Maß an Fotorealismus.

Der Reality Keyer™ stellt spektakuläre Ergebnisse für das Keying von Kontaktschatten, transparenten Objekten und Sub-Pixel-Details bereit, wie beispielsweise für die Darstellung von Haar.

Die Zero Density Reality Engine™ setzt Bilder durch die Verwendung von 16-bit-Fließkomma-Berechnungen zusammen, was einen branchenweit einzigartigen Ansatz darstellt. Wenn die Kontrolle über die gesamte Compositing Pipeline zur Verfügung steht, werden alle Gamma- und Farbraumumwandlungen korrekt abgewickelt. Mithilfe dieser Technologie wird die reale Welt auf perfekte Weise mit den virtuellen Elementen verschmolzen.

Bei Verwendung des nachverfolgten Kamerafeeds als Eingangsbild kann die Reality Engine™ die Lichtreflexionen und -brechungen der realen Umgebung auf den virtuellen Objekten rendern. Echtzeit-3D-Reflexionen und die Schatten von virtuellen Objekten werden auch über den eingehenden Kamerafeed überlagert.

Echtes Stadion-Feeling: virtuelle Fans, wirkungsvolle Werbung und noch mehr Unterhaltung

Mit modernster Technologie zu mehr Stadionatmosphäre

Sportveranstaltungen finden zwar wieder statt, die Zuschauertribünen bleiben allerdings leer. Das Publikum verfolgt das Geschehen daher verstärkt vom Sofa aus, vermisst aber die Stimmung im Fanblock. Die aktuelle Situation bietet jedoch viel Potenzial für kreative Lösungen. Hier finden Sie ein Beispiel dafür, wie Zero Density und Dreamwall die Stadionatmosphäre mithilfe neuester Technologien wie der PTZ-Kamera AW-UE150 ins Wohnzimmer bringen.

Produktgalerie

Ressourcen & Downloads

Showing 12 of 18

Sorry there was an error...

The files you selected could not be downloaded as they do not exist.

Sie haben Dokument ausgewählt..

Continue to select additional items or download selected items together as a zip file.

Sie haben 1 Dokument ausgewählt.

Wählen Sie weitere Dokumente aus oder laden Sie die aktuelle Auswahl herunter.

Seite teilen

Share this link via:

Twitter

LinkedIn

Xing

Facebook

Or copy link: